Projekt-Erfolgsstorys - Laufzeitkameras bereichern die Welt der Kommunikation

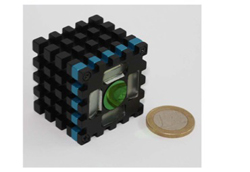

Die Bedeutung dieser Technologie lässt sich am Schicksal eines Einzelnen erkennen: Thomas ist ein völlig gelähmter junger Mann. Der Tetraplegiker kann seinen Kopf nur mühsam millimeterweise von einer Seite zur anderen bewegen. Es ist die einzige Bewegung, zu der er überhaupt in der Lage ist. Dank der neuen, von europäischen Forschern entwickelten 3D-Laufzeit-Hard- und Software (Time-of-flight, TOF) genügt diese winzige Bewegung, um ein kostengünstiges Eingabegerät für einen Computer zu steuern - und plötzlich erschließt sich Thomas die ganze Welt der Kommunikation. Dieses fiktive Szenario veranschaulicht die Macht und den Stellenwert dieser neuen bahnbrechenden Technologie, die vor kurzem innerhalb eines EU-finanzierten Forschungsprojekts geschaffen wurde. Aufgabe des Projekts ARTTS ("Action recognition and tracking based on time-of-flight sensors") ist nun, die zugrunde liegende Technologie zu verbessern und neue Algorithmen, d.h. Codes zu entwickeln, die die Sensoren zur Objekterkennung und -verfolgung steuern. Laufzeitkameras sind eine hochmoderne Technik mit großer Zukunft. "Microsoft hat vor kurzem die israelische TOF-Firma 3DV Systems gekauft, da man die Technologie in der Konsole der nächsten Generation nutzen will", erklärt Professor Erhardt Barth, stellvertretender Direktor des Instituts für Neuro- und Bioinformatik an der Universität Lübeck, Deutschland, und Koordinator des ARTTS-Projekts. "Hauptanliegen unserer Forschungsarbeit war die Mensch-Computer-Interaktion mit Hilfe von Laufzeittechnik." Das hinter Laufzeittechnologie (TOF) stehende Prinzip ist recht einfach. Der Sensor misst die Zeit, die das Licht von der Kamera bis zu einem Objekt und wieder zurück unterwegs ist - die "Time-of-flight", also die "Flugzeit" - und verwendet diese Daten, um den Abstand zu diesem Objekt zu berechnen. Es ist eine 3D-Kamera, ähnlich wie bei Stereovision und Laserscannern, aber entschieden preiswerter und flexibler als diese. Schneller, schlanker, billiger Mit diesem Ziel vor Augen mussten sich die Forscher auf ein sehr ehrgeiziges Arbeitsprogramm einlassen. Sie mussten die Laufzeitkameras über alle derzeit verfügbare Technik hinweg verbessern - Tiefenauflösung und Qualität des Signals steigern sowie gleichzeitig Größe, Stromverbrauch und Kosten reduzieren. "Wir mussten zeigen, dass man Sensoren entwickeln kann, die so klein sind, dass man sich durchaus vorstellen kann, sie in Webcams, Rechnern und sogar Mobiltelefonen einzusetzen", betont Prof. Barth. "Das wirklich Neue an dieser Kamera ist, dass sie weitaus kleiner und stromsparender ist, als alle anderen Vorgängermodelle. Sie benötigt nur einen USB-Anschluss für Strom und verfügt immer noch über die Eigenschaften der anderen Geräte, die viel größer und schwerer sind und mehr Energie verbrauchen." Aber kleiner, preiswerter und effizienter war nicht genug - die Kamera musste auch noch genau sein. "Präzision ist ein weiterer wichtiger Punkt", erklärt Prof. Barth. "Diese Kamera arbeitet mit aktiver Beleuchtung; es gibt einige Infrarotdioden in der Kamera, aber das Besondere an dieser Beleuchtung ist, dass sie moduliert wird: Die Helligkeit ändert sich im Lauf der Zeit sehr schnell und so hängt die Genauigkeit von dieser Frequenz ab – davon, wie schnell sich diese Beleuchtung verändert. Wir haben es hinbekommen, eine 60-Megahertz-Lichtquelle zu bauen. Sie verändert sich 60 Millionen Mal pro Sekunde, was die Kamera im Nahbereich viel genauer macht." Andere Kameras sind eher für den Fernbereich, ein bis sieben Meter und darüber hinaus optimiert, aber die ARTTS-Kamera ist innerhalb eines Meters genauer. Und das ist der passende Abstand zur Verwendung von Gesten bei Smartphones. "Das iPhone hat die Leute mit dem Einsatz von Gesten vertraut gemacht und so wäre der nächste Schritt die Interaktion ohne Berührung - und das ist die Stelle, an der wir mitmischen." "So dürfte die vom Partner CSEM entwickelte ARTTS-Kamera wohl tatsächlich das wichtigste Konkurrenzprodukt zu dem sein, vorüber Microsoft jetzt verfügt. Ich gehe mal davon aus, dass unser Produkt besser ist, aber es muss noch weiter daran gearbeitet werden, bis es reif für den Massenmarkt ist", betont Prof. Barth. Duale Kamera Das Team entwickelte außerdem eine zweite Kamera, die sowohl einen niedrig auflösenden TOF-Sensor als auch einen Bildsensor mit HDTV-Qualität (hoch auflösendes Fernsehen) enthält. "Der Partner SMI geht davon aus, dass dieser Sensor eine bessere Funktionalität für Sicherheit und Gesundheitswesen bieten kann, wenn Video-Links zu älteren Menschen und eine Alarmierung von Pflegepersonal erstellt werden, wenn zum Beispiel ein Patient ein Problem hat", erzählt Prof. Barth. So könne das Gerät beispielsweise Personen in ihrer Bewegung durch den Raum verfolgen und ihre Handlungen erkennen. Barth ist guten Mutes, was diese Kamera angeht, da auch ein TOF-Sensor mit niedriger Auflösung sehr brauchbare Distanzdaten liefert, wohingegen ein Bildsensor mit niedriger Auflösung weniger nützlich ist. "Ich glaube, diese Art Dual-Kamera wird für die meisten Umgebungen und Geräte ideal sein", stellt er fest. "Im Grunde kommt hier einfach ein Strahlteiler zur Anwendung, der das infrarote Licht zum TOF-Sensor und das sichtbare Licht zum Bildsensor schickt. Strahlteiler sind eine ausgereifte, kostengünstige Technologie, die bei Camcordern bereits im breiten Einsatz ist." Entspricht die Hardware dem neuesten Stand der Technik, so ist die Software von wesentlicher Bedeutung für die Funktion. In diesem Bereich arbeiteten Universitätsteams aus Dänemark, Rumänien und Deutschland an drei Problemen. Das erste war von allgemeiner Art: Das Team versuchte einfach, die Qualität des Signals aus den TOF-Sensoren erheblich zu verbessern und setzte dabei einige sehr geniale Lösungen um. Zum Beispiel erkannte Barths Gruppe, dass Lichtintensität und die Entfernung nicht voneinander unabhängige Werte sind, sondern durch Schattierungsbedingungen miteinander in Beziehung stehen. Wenn die Reflexionseigenschaften des beobachteten Objekts bekannt sind, kann die Qualität der Bereichsdarstellungen - objektiv und subjektiv - drastisch verbessert werden, indem Schattierungsbedingungen aufgestellt werden. Auch andere Lösungen trugen zur weiteren Verbesserung des Signals bei. Das zweite Software-Ziel bestand darin, einen Algorithmus zur Objektverfolgung zu entwickeln. "Ich habe ziemlich viel Zeit mit Versuchen verbracht, menschliche Merkmale wie Augen und Nase zu verfolgen - das ist nicht so ganz simpel", verrät Prof. Barth, "besonders wenn man an Orten wie etwa in einem Auto arbeiten muss, wo sich das Licht ständig verändert." Feinfühlige Wahrnehmung Die TOF -Sensoren funktionieren daher dual: mit einer Abstandsdarstellung und einer Lichtintensitäts-Darstellung. Kombiniert mit der Abstandsdarstellung ist die Intensitätsdarstellung gut genug, um nützliche Anwendungen zu ermöglichen. Durch diese Kombination von Informationen konnte man bei ARTTS beispielsweise verschiedene Objektverfolgungsalgorithmen entwickeln, die Menschen verfolgen können, weil der Abstand ein Maß liefert, das durch ein anderes Maß - von dem Lichtintensitätssignal - bestätigt wird. Dies ist eine wichtige Grundlage für die Arbeit der anderen Teams. Sobald das System in der Lage ist, ein Objekt zuverlässig zu verfolgen, ist es bereit, die Erkennung von Gesten zu erlernen, was von Beginn an das wichtigste Ziel des ARTTS-Projekts war. Und es stellte sich heraus, dass das ARTTS-System sogar recht subtile Gesten erkennen kann. Auch wenn es bei jedem Bildelement, dem man einen Abstandswert zuordnet, Messfehler geben kann, so gibt es doch eine ganze Menge an Pixeln. Dies entspricht dann vielen Werten mit einer durchschnittlichen Summe, die die Sensitivität dramatisch erhöht. In seiner aktuellen Version kann das System sogar eine Diashow-Präsentation mit Handbewegungen zum Zeigen, Wechseln der Dias, Rückspringen und mehr steuern. Es gibt unendlich viele mögliche Anwendungsmöglichkeiten dieser Technologien. Das Projekt erhielt nach einem hart umkämpften Antragsverfahren 400 000 EUR aus den Fördermitteln der deutschen Regierung, um ein Unternehmen neu zu gründen, das Technologien und Dienstleistungen anbietet. Die Kunden können eine Hardware- und Softwareplattform kaufen, um eigene Anwendungen zu entwickeln oder sie können die neue Firma TOF-GT anheuern, um die Anwendung für sich entwickeln zu lassen. Derzeit entwickelt das Team eine Werbeanwendung für den Wiener Bahnhof. Sie besteht aus einem 12 Meter breiten hochauflösendem Bildschirm und einer Reihe von Laufzeitkameras. Die Kameras werden es den Passanten ermöglichen, mit dem Bildschirm zu interagieren, wenn Werbung abgespielt wird. Denkbar ist auch die Durchführung von Umfragen oder die Verarbeitung von Kundeninformationen. Das Team erwägt derzeit überdies eine kleinere Version für den Gebrauch in Geschäften oder Einkaufszentren. Einsatz in der Gehirnchirurgie Das Team arbeitet gleichfalls mit Neurochirurgen und einem Unternehmen für medizinische Instrumente zusammen, um Gesten für den OP-Saal zu entwickeln. Neurochirurgen nutzen eine riesige Menge von Informationen in einer Vielzahl von Formaten - Bilder, Vitalparameter, Anzeigewerte einer großen Zahl von Instrumenten. "Zurzeit muss ein Chirurg erst sein Instrument beiseite legen, um die Datenanzeige zu ändern, und erst anschließend kann es weitergehen. Wir aber werden ein System entwickeln, das Änderungen in Reaktion auf bestimmte Gesten möglich macht. Hier handelt es sich nicht nur um ein Forschungsprojekt; es wird zu einer neuen Anwendung führen." Es ist ein Vorgeschmack auf die Dinge, die in Bezug auf diese Technologie kommen werden. Die breiteste derzeitige Anwendung der TOF-Sensoren ist in der Milchwirtschaft zu finden. Die Sensoren kommen in automatischen Melkmaschinen zum Einsatz, um das Euter der Kuh anzuschließen. Die potenziellen Anwendungsmöglichkeiten für TOF-Sensoren sind allerdings buchstäblich grenzenlos. Und nun sind diese Sensoren dank des ARTTS-Projekts klein, bezahlbar, effizient sowie für Objektverfolgung und Gestenerkennung optimiert. ARTTS erhielt Finanzmittel aus dem IKT-Bereich des Sechsten EU-Rahmenprogramms für Forschung.