Une recherche décrypte comment notre cerveau utilise la vision pour planifier des préhensions fermes

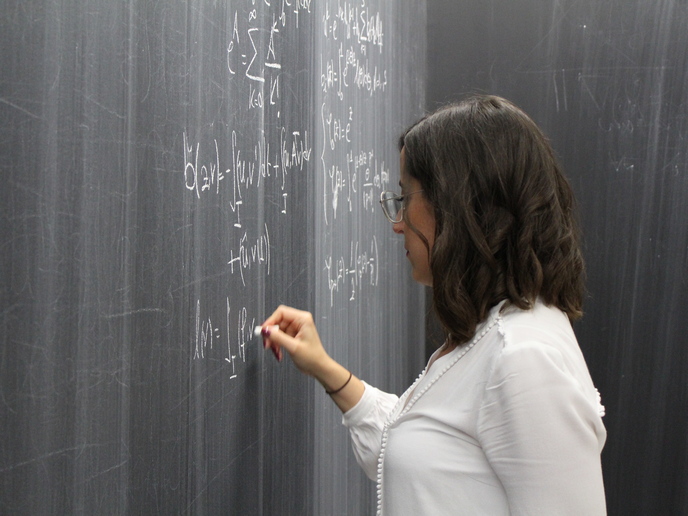

Notre sens de la vue guide nos actions envers les objets. Par exemple, si nous demandions à quelqu’un de nous passer le sel, il le chercherait d’abord sur la table, puis le saisirait avec sa main. La façon dont notre cerveau accomplit ce comportement apparemment trivial est encore loin d’être comprise. Pour toute action souhaitée, qu’il s’agisse de verser une tasse de café ou de diriger un stylo entre le pouce et l’index sur un morceau de papier, nous bougeons nos doigts de manière subtile, ce qui nous permet d’exécuter des prises fermes et confortables. Le cerveau détermine quelle prise parmi tous les choix possibles sera effectivement la bonne. Comprendre comment nous utilisons la vision pour saisir des objets aléatoires et interagir efficacement avec ceux-ci constitue une quête de longue date dans le domaine des sciences du comportement. Il s’agit également d’un énorme défi informatique pour les systèmes robotiques de pointe; ceux-ci semblent avoir du mal à identifier visuellement les saisies fructueuses dans près de 20 % des cas»(s’ouvre dans une nouvelle fenêtre), fait remarquer Guido Maiello, coordinateur du projet VisualGrasping, financé par le programme Marie Skłodowska-Curie.

Découvrir la façon dont le cerveau combine différentes règles en un seul mouvement

«Nous avons émis l’hypothèse que le cerveau utilise un ensemble de règles pour identifier les saisies fructueuses. Celles-ci devraient reposer sur des informations concernant la forme 3D de l’objet, son orientation et la composition de ses matériaux», ajoute Guido Maiello. En fixant de petits marqueurs sur les mains de volontaires rémunérés, les chercheurs ont enregistré la façon dont ils déplaçaient leurs mains tout en interagissant avec des objets faits de différents matériaux. Certains objets ont été imprimés en 3D pour créer des formes complexes. L’équipe a combiné ces observations comportementales avec des modèles informatiques capables de prédire la façon dont les humains saisiraient les objets. Leurs simulations semblaient correspondre parfaitement aux résultats expérimentaux.

Décoder la façon dont le cerveau appréhende le monde en 3D

Poussant plus loin, les chercheurs ont cherché à déterminer comment le cerveau reconstruit la forme 3D de l’objet à partir des images 2D qui atteignent nos yeux. Guido Maiello déclare: «La troisième dimension que les humains perçoivent avec leur vision provient du cerveau qui combine des images disparates (de gauche et de droite) en un tout — un phénomène appelé stéréopsie. Cependant, la structure de notre rétine et les capacités de traitement de l’information de notre cerveau entraînent des reconstructions imparfaites de notre environnement en 3D.» Pour mieux comprendre ces limites, les chercheurs ont demandé aux participants d’observer des images stéréoscopiques et de rendre compte de la profondeur perçue. Les résultats se sont avérés conformes aux approches de modélisation théorique qui tentent de décrire comment notre cerveau extrait et traite la profondeur à partir d’images 2D. «Nos modèles sophistiqués pourraient être les éléments de base d’une théorie complète sur la façon dont les humains utilisent la vision pour guider la motricité des mains. En particulier, nous cherchons à mieux comprendre comment les entrées visuelles captées et converties en signaux électrochimiques dans la rétine sont introduites et traitées par le réseau complexe de cellules nerveuses des cortex visuel et moteur. Ces calculs neuronaux permettent les commandes motrices explicites qui régissent les mouvements d’extension et de préhension», explique Guido Maiello. Les connaissances acquises dans le cadre du projet sur la façon dont les humains utilisent la vision pour planifier leurs prises pourraient avoir des implications considérables dans différentes applications techniques, telles que la conception d’actionneurs robotiques plus performants et de technologies de réalité augmentée plus immersives et plus conviviales. Dans le domaine médical, elles pourraient permettre d’obtenir un degré de contrôle spectaculaire pour les troubles neurologiques et la neuroréhabilitation et, apparemment, contribuer à découvrir les mécanismes de la perte visuelle.