Jak nasz mózg wykorzystuje wzrok do planowania pewnego chwytania przedmiotów

Zmysł wzroku kieruje naszymi ruchami w kierunku przedmiotów. Na przykład, jeśli ktoś zostanie poproszony o podanie soli, najpierw szuka jej na stole, a następnie chwyta ręką. Nadal jednak jesteśmy dalecy od zrozumienia, w jaki sposób naszemu mózgowi udaje się wykonać tę pozornie banalną czynność. W przypadku każdej czynności, czy to mieszania kawy w filiżance, czy prowadzenia długopisu między kciukiem a palcem wskazującym po kartce papieru, poruszamy palcami w subtelny sposób, który pozwala nam na stabilne, wygodne chwytanie przedmiotów. W jakiś sposób mózg ustala, który chwyt spośród wszystkich możliwości będzie skuteczny. „Nauki behawioralne od dawna starają się zrozumieć, w jaki sposób wykorzystujemy wzrok do chwytania i manipulowania dowolnymi przedmiotami. Ponadto jest to ogromne wyzwanie obliczeniowe dla nowoczesnych systemów zrobotyzowanych – nie potrafią one poradzić sobie z wizualną identyfikacją skutecznych chwytów w prawie 20 % przypadków(odnośnik otworzy się w nowym oknie)”, zauważa Guido Maiello, koordynator projektu VisualGrasping finansowanego ze środków działania „Maria Skłodowska-Curie”.

Poznać sposób, w jaki mózg łączy różne zasady w jednym ruchu

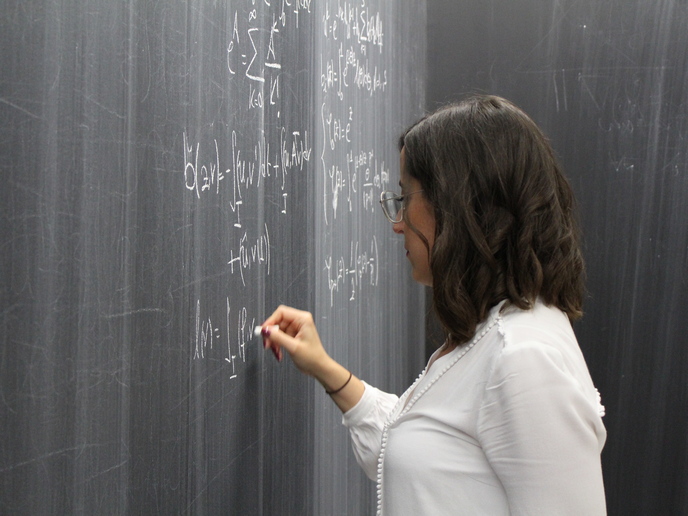

„Wysunęliśmy hipotezę, zgodnie z którą mózg używa zestawu zasad, aby zidentyfikować skuteczne chwyty. Przypuszczalnie opierają się one na informacjach o trójwymiarowym kształcie przedmiotu, jego orientacji i składzie materiałowym”, dodaje Maiello. Naklejając małe znaczniki na dłonie uczestników badania, uczeni rejestrowali, w jaki sposób poruszali oni rękami podczas interakcji z przedmiotami wykonanymi z różnych materiałów. Niektóre obiekty były drukowane w 3D w celu uzyskania złożonych kształtów. Zespół połączył te obserwacje behawioralne z modelami komputerowymi, które pozwalały przewidzieć, jak ludzie będą chwytać przedmioty. Symulacje wydawały się idealnie odpowiadać wynikom eksperymentu.

Jak mózg postrzega świat w trzech wymiarach

Idąc o krok dalej, naukowcy starali się ustalić, w jaki sposób mózg odtwarza trójwymiarowy kształt przedmiotu na podstawie dwuwymiarowych obrazów docierających do oczu. Maiello tłumaczy: „Trzeci wymiar postrzegany przez człowieka za pomocą wzroku uzyskiwany jest w ten sposób, że mózg łączy różne obrazy (lewy i prawy) w jedną całość w procesie nazywanym stereopsją. Struktura naszych siatkówek i zdolności przetwarzania informacji przez nasz mózg powodują jednak niedoskonałość rekonstrukcji trójwymiarowego środowiska”. W celu dalszego zbadania tych ograniczeń, naukowcy poprosili uczestników o oglądanie obrazów stereo i wypowiedzenie się na temat postrzeganej głębi. Wyniki okazały się odpowiadać modelowaniu teoretycznemu, które próbuje opisać, jak nasz mózg wyodrębnia i przetwarza głębię z dwuwymiarowych obrazów. „Nasze wyrafinowane modele mogą być podstawą do opracowania wszechstronnej teorii dotyczącej tego, w jaki sposób ludzie wykorzystują wzrok do kontrolowania ręcznych czynności motorycznych. W szczególności chcielibyśmy wyjaśnić, w jaki sposób odbierane sygnały wizualne, przetworzone w sygnały elektrochemiczne w siatkówce oka, są przesyłane do i przetwarzane przez złożoną sieć komórek nerwowych w korze wzrokowej i motorycznej. Obliczenia te uwzględniają wyraźne polecenia motoryczne, które precyzyjnie regulują ruchy sięgania i chwytania”, wyjaśnia Maiello. Zdobyta w projekcie wiedza na temat tego, w jaki sposób ludzie wykorzystują wzrok do planowania chwytów, może mieć daleko idące implikacje dla różnych zastosowań inżynieryjnych, takich jak projektowanie bardziej efektywnych siłowników robotycznych oraz bardziej wciągających i przyjaznych dla użytkownika technologii rzeczywistości rozszerzonej. W medycynie mogą one umożliwić znaczną poprawę zdolności kontroli w leczeniu zaburzeń neurologicznych i neurorehabilitacji, a także przydać się w badaniu mechanizmów utraty wzroku.