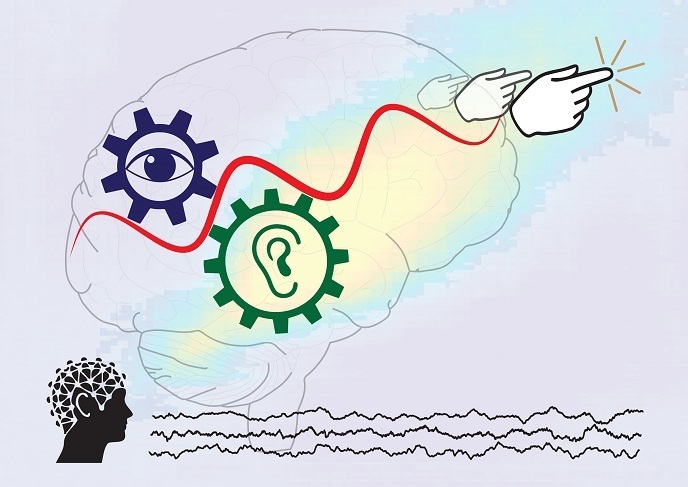

Verarbeitung von Seh- und Hörreizen aus der Umgebung für mehrere Sinne gleichzeitig

Die Verknüpfung von Informationen aus verschiedenen Sinnesmodalitäten unterstützt die Auswahl und die Generierung der entsprechenden Reaktion. Wenn beispielsweise ein Reiz „sehr deutlich visuell wahrgenommen wird, benötigen wir nicht zwangsläufig multisensorische Mechanismen, um zu entscheiden, ob eine Reaktion notwendig ist. Wenn wir jedoch in der Abenddämmerung durch den Wald laufen, können wir durch ein leises Heulen den kaum erkennbaren Hund im aufsteigenden Nebel wahrnehmen. In derartigen Kontexten ist die Verknüpfung zweier Informationen unerlässlich, um zu entscheiden, ob wir reagieren müssen“, bemerkt Manuel Mercier, Koordinator des EU-finanzierten Projekts MIMe.

Von getrennt zu multimodal

Im Rahmen des über Marie-Skłodowska-Curie-Maßnahmen finanzierten Projekts MIMe wurde diese komplexe Interaktion zwischen den Sinnen und der Entscheidungsfindung untersucht. Die wahrnehmende Entscheidungsfindung – der Prozess, der unser Verhalten steuert – kann in eine Phase der sensorischen Codierung (in der ein sensorisches Signal im entsprechenden sensorischen Kortex codiert wird) und eine Phase der Entscheidungsbildung unterteilt werden. „Wir wollten herausfinden, ob sensorische Reize, die über unterschiedliche Sinne wahrgenommen worden sind, ab dem Zeitpunkt, zu dem sie in das Gehirn einströmen – nämlich in der Codierungsphase – oder während der Entscheidungsbildungsphase miteinander verknüpft werden. Außerdem wollten wir die neuronalen Mechanismen und die neuronale Architektur ermitteln, die der multisensorischen Konvergenz unterliegen“, erklärt Mercier.

Orchestrierung von Gehirnoszillationen

Neue Ergebnisse, die jüngst Aufmerksamkeit erregten, legen nahe, dass die Informationsübertragung in den Hirnschaltkreisen auf neuronalen Oszillationen(öffnet in neuem Fenster) beruhen, die Variationen der neuronalen Aktivität reflektieren. Wenn zwei Neuronengruppen synchron oszillieren, ist ein Informationsaustausch wahrscheinlicher. Auch wenn zu diesem Thema weitere Forschung erforderlich ist, zeigen diese Ergebnisse einen potenziellen neuronalen Mechanismus auf, mit dem das Gehirn sensorische Reize verknüpft und so ein multimodales Konstrukt erstellt. „Im Rahmen von MIMe wurde untersucht, ob die multimodale Assoziation auf der Phasensynchronisation zwischen entfernten Knoten des Neuronennetzes beruht“, ergänzt Mercier.

Formgebung des Gehörten

Zur Umsetzung seiner Ziele führte das Projektforschungsteam zunächst eine Studie an Patientinnen und Patienten mit für klinische Zwecke implantierten intrakraniellen Elektroden durch. Der Schwerpunkt lag dabei auf der Aufzeichnung intrakranieller neuronaler Oszillationen, während den Teilnehmenden Bilder, auf denen Scheinkonturen wahrgenommen werden, zusammen mit einem Ton präsentiert wurden. Interessanterweise stellten die Forschenden eine starke Synchronisation der oszillatorischen Aktivität des visuellen und des auditorischen Kortex fest. „Die Kommunikation zwischen den entfernten Neuronenpopulationen repräsentiert die Codierung eines multimodalen Objekts: Die auditorischen Reize beeinflussten das, was die Patientinnen und Patienten zu sehen glaubten, nämlich die Form, die durch die Scheinkonturen entstand“, so Mercier.

Multisensorische Integration ist allgegenwärtig im Gehirn

In einer weiteren Studie wurde den Teilnehmenden eine dynamische Sequenz auditiver und visueller Signale dargeboten. Das Ziel war dabei, zu untersuchen, wie sie komplexe Berechnungen durchführten und auf bestimmte Reizkombinationen reagierten. Unter Anwendung von Methoden des maschinellen Lernens analysierten die Forschenden die elektrische Aktivität im Gehirn und stellten fest, dass die multisensorische Integration(öffnet in neuem Fenster) die Dynamik im Gehirn während der Phase der sensorischen Codierung und während der Phase, in der die Teilnehmenden die Entscheidung über ihre Reaktion trafen, beschleunigt. Die Ergebnisse von MIMe zeigten, dass die multisensorische Integration im menschlichen Gehirn allgegenwärtig ist und verschiedene Prozesse in der Verarbeitungshierarchie übernimmt. „Das tiefgreifende Verständnis der neuronalen Dynamik, die zwischen den Sinnen bei der Entscheidungsbildung abläuft, wird neues Licht auf die Schwierigkeiten, denen sich manche Menschen – wie Menschen mit autistischen Zügen – gegenübersehen, werfen“, schließt Mercier.