Desarrollar tecnologías, pero sin olvidar la ética

Los sistemas de información inteligentes (SIS, por sus siglas en inglés) están cambiando nuestras vidas. Estos sistemas, que se desarrollaron a partir de la inteligencia artificial y el análisis de datos masivos, contribuyen a la sociedad de manera importante, desde la prevención de enfermedades hasta la reducción de los delitos. Por desgracia, también se usan de maneras más negativas, como para proporcionar calificaciones de belleza para que personas igualmente atractivas coincidan en aplicaciones de citas o para usar las fotos de las personas y predecir su índice de masa corporal (IMC) para las pólizas de seguro médico. Para contrarrestar el efecto perjudicial que estos usos tienen en la sociedad y sus valores, el proyecto SHERPA, financiado con fondos europeos, está investigando las diferentes maneras en las que los SIS afectan las cuestiones éticas y de derechos humanos.

No aceptar el reconocimiento facial a ojos cerrados

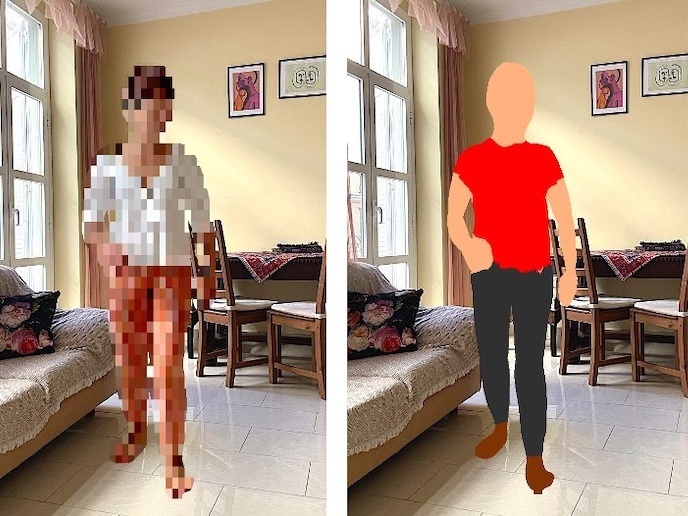

Con el fin de que la gente cuestione la confiabilidad de los algoritmos de reconocimiento facial, Tijmen Schep, un artista que forma parte del consorcio SHERPA, creó un documental interactivo titulado «How Normal Am I»(se abrirá en una nueva ventana) («¿Qué tan normal soy?»). Diseñado como una prueba, el documental le muestra cómo se utilizan los algoritmos de reconocimiento facial para juzgarlo. En unos pocos minutos, su rostro es analizado y calificado en términos de edad, belleza y género. También se utiliza para evaluar su estado emocional y estimar su IMC y esperanza de vida. Schep comentó en el documental: «A medida que la tecnología de reconocimiento facial se introduce en nuestra vida diaria, puede crear esta sensación sutil pero omnipresente de estar siendo observado y juzgado todo el tiempo. Podría sentir más presión para comportarse “normalmente”, lo que para un algoritmo significa ser más promedio. Por eso tenemos que proteger nuestro derecho humano a la privacidad, que es básicamente nuestro derecho a ser diferentes. Podría decirse que la privacidad es un derecho a ser imperfectos». En el documental, se destaca la poca fiabilidad de los algoritmos de reconocimiento facial cuando se evidencia que manipular los resultados es bastante fácil. Por ejemplo, mover la cabeza hacia arriba y hacia abajo altera la predicción de la edad y simplemente levantar las cejas puede dar lugar a un resultado de IMC más bajo. Además, las evaluaciones de belleza del algoritmo están sesgadas, ya que se basan en las calificaciones de belleza proporcionadas solamente por estudiantes chinos. Los modelos de inteligencia artificial utilizados en el documental se ejecutan en el propio navegador del espectador, por lo que no se envían datos personales a la nube.

La privacidad en el hogar

Tijmen Schep trabajó como diseñador principal de otro sistema respaldado por SHERPA que nos hace reflexionar sobre cómo sería un hogar inteligente si la privacidad fuera la prioridad principal. El nuevo sistema de domótica inteligente respetuoso con la privacidad, Candle(se abrirá en una nueva ventana), fue diseñado para almacenar todos los datos dentro del hogar y no necesita una conexión a internet para funcionar. Esto se debe a que, a diferencia de otros sistemas de domótica inteligentes, viene con un control de voz completamente local. Entre las características de Candle se encuentran los sensores de temperatura, humedad, nivel de CO2, polvo y uso de electricidad, así como las alarmas y las cerraduras inteligentes. Con el objetivo de reconstruir la confianza de las personas en los SIS, que se ha visto dañada tras varios escándalos de violación de la privacidad, los creadores de Candle han puesto el código fuente a disposición de forma gratuita. «Nuestro objetivo es impulsar la industria hacia productos respetuosos con la privacidad al mostrar ejemplos innovadores de cómo podrían verse estos productos», afirmó Schep en el sitio web de Candle. El objetivo del proyecto SHERPA [Shaping the ethical dimensions of smart information systems (SIS) – a European perspective] es encontrar soluciones sostenibles que beneficien no solo a los innovadores de tecnologías sino también a la sociedad que las utiliza. El proyecto concluirá en octubre de 2021. Para obtener más información, consulte: Sitio web del proyecto SHERPA(se abrirá en una nueva ventana)