Développer les technologies sans compromettre l’éthique

Les systèmes d’informations intelligents (SII) bouleversent nos vies. Évoluant de l’IA à l’analyse des mégadonnées, ces systèmes apportent une contribution significative à la société, de la prévention contre les maladies à la réduction du crime. Malheureusement, ils sont également utilisés de manière plus négative, par exemple en fournissant des scores de beauté pour associer des personnes tout aussi séduisantes dans des applications de rencontre ou en utilisant les photos des personnes pour prédire leur indice de masse corporelle (IMC) pour les contrats d’assurance maladie. Pour contrecarrer les effets néfastes de ces utilisations sur la société et ses valeurs, le projet SHERPA, financé par l’UE, étudie les différentes façons dont les SII affectent les questions en matière d’éthique et de droits de l’homme.

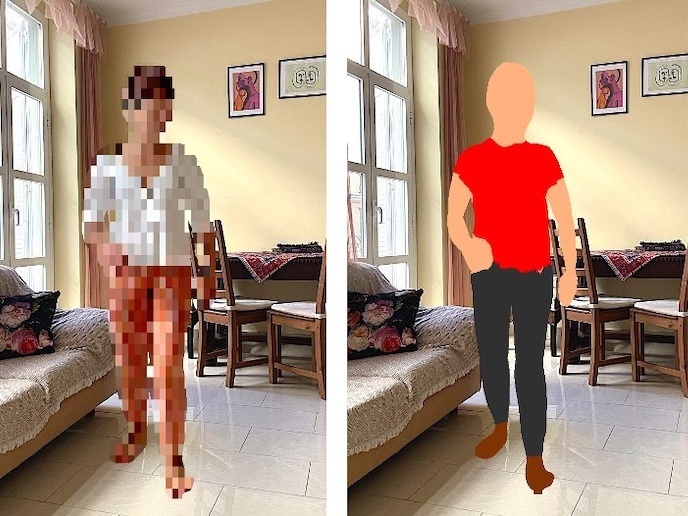

Pas de délit de faciès pour la reconnaissance faciale

Dans l’espoir que les personnes remettent en cause la fiabilité des algorithmes de reconnaissance faciale, Tijmen Schep, un artiste issu du consortium SHERPA, a créé un documentaire interactif intitulé «How Normal Am I»(s’ouvre dans une nouvelle fenêtre) ou «Dans quelle mesure suis‑je normal(e)» en français. Se présentant sous la forme d’un test, ce documentaire vous montre comment les algorithmes de reconnaissance faciale sont utilisés pour vous juger. En seulement quelques minutes, votre visage est analysé et noté en termes d’âge, de beauté et de genre. Il est également utilisé pour évaluer votre état émotionnel et estimer votre IMC et votre espérance de vie. «Alors que la technologie de reconnaissance faciale s’immisce dans nos vies, elle peut susciter ce sentiment subtil et pourtant omniprésent d’être observé et jugé en permanence», a commenté Tijmen Schep dans le documentaire. «Vous pourriez ressentir une pression supplémentaire vous poussant à vous comporter “normalement”, ce qui, pour un algorithme, signifie se situer davantage dans la moyenne. C’est pourquoi nous devons protéger notre droit à la vie privée, qui représente en réalité notre droit à la différence. On pourrait dire que la vie privée est le droit à être imparfait.» La non‑fiabilité des algorithmes de reconnaissance faciale est mise en avant dans le documentaire, lorsqu’il devient évident qu’il est assez simple de modifier les scores. Par exemple, le fait de hocher la tête de haut en bas altère la prédiction de l’âge et celui de simplement lever vos sourcils peut aboutir à un score IMC plus faible. En outre, les évaluations de l’algorithme en termes de beauté sont biaisés car elles se basent sur les scores de beauté fournis uniquement par des étudiants chinois. Les modèles d’IA utilisés dans le documentaire fonctionnent dans le navigateur du spectateur, de sorte qu’aucune donnée personnelle n’est envoyée dans le cloud.

Vie privée chez soi

Tijmen Schep a été le concepteur principal d’un autre système soutenu par SHERPA qui nous fait réfléchir à ce à quoi ressemblerait une maison intelligente si la vie privée était la priorité absolue. Dénommé Candle(s’ouvre dans une nouvelle fenêtre), ce nouveau système de maison intelligente respectueux de la vie privée a été conçu pour stocker l’ensemble des données au sein du foyer et ne requiert aucune connexion Internet pour fonctionner. Cela est possible car, contrairement aux autres systèmes de maison intelligente, il s’accompagne d’une commande vocale entièrement locale. Les caractéristiques de Candle incluent des capteurs de température, d’humidité, des niveaux de CO2, de poussière et d’utilisation de l’électricité, ainsi que des alarmes et des systèmes de verrouillage intelligents. Dans l’optique de restaurer la confiance des personnes dans les SII qui a été endommagée suite à divers scandales de violation de la vie privée, les créateurs de Candle ont rendu le code source librement accessible. «Notre objectif consiste à accélérer l’adoption par l’industrie de produits respectueux de la vie privée en montrant des exemples innovants de ce à quoi ces produits pourraient ressembler», a déclaré Tijmen Schep sur le site web de Candle. SHERPA (Shaping the ethical dimensions of smart information systems (SIS) – a European perspective) entend identifier des solutions durables qui profiteraient non seulement aux innovateurs des technologies, mais également à la société qui les utilise. Le projet prendra fin en octobre 2021. Pour plus d’informations, veuillez consulter: site web du projet SHERPA(s’ouvre dans une nouvelle fenêtre)