Sviluppare tecnologie senza dimenticare l’etica

I sistemi informativi intelligenti ci stanno cambiando la vita. Evolvendosi dall’IA e da analisi di megadati, essi contribuiscono alla società in maniera notevole, spaziando dalla prevenzione delle malattie alla riduzione del crimine. Tuttavia, questi sistemi sono impiegati anche in modo più negativo: ad esempio, forniscono punteggi sulla bellezza per abbinare persone ugualmente attraenti nelle app di appuntamenti, oppure utilizzano le fotografie delle persone per prevederne l’indice di massa corporea (IMC) per le polizze assicurative sanitarie. Per contrastare gli effetti dannosi di tali pratiche sulla società e sui suoi valori, il progetto SHERPA, finanziato dall’UE, sta esaminando i diversi modi in cui i sistemi informativi intelligenti condizionano gli aspetti relativi a etica e diritti umani.

Non fermarsi alle apparenze del riconoscimento facciale

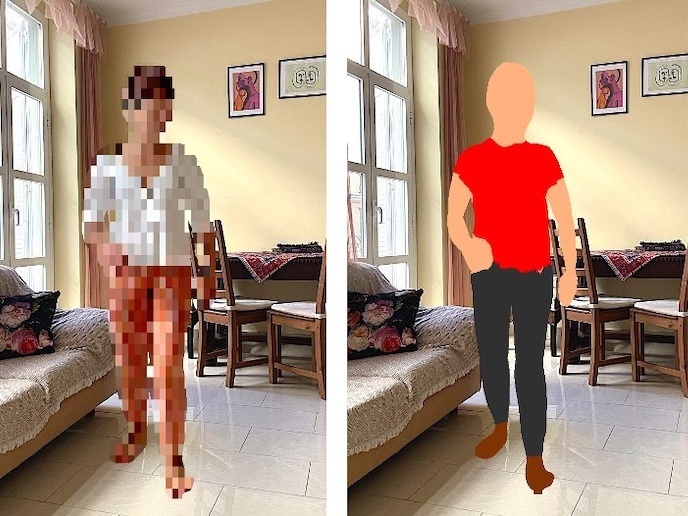

Auspicandosi di condurre le persone a interrogarsi sull’affidabilità degli algoritmi di riconoscimento facciale, Tijmen Schep, artista parte del consorzio del progetto SHERPA, ha realizzato un documentario interattivo intitolato «How Normal Am I», Quanto risulto normale(si apre in una nuova finestra). Assumendo la forma di un test, il documentario mostra come sono adoperati gli algoritmi di riconoscimento facciale per giudicarci. In una manciata di minuti, il nostro viso viene analizzato e valutato in termini di età, bellezza e genere. Inoltre, in questo modo si valuta lo stato emotivo e si effettua una stima dell’IMC e dell’aspettativa di vita. Nel documentario Schep commenta: «La sempre più crescente presenza della tecnologia di riconoscimento facciale nella nostra vita quotidiana può provocare in noi la sensazione lieve, ma dilagante, di essere costantemente osservati e giudicati». «Potremmo sentirci più spinti a comportarci “normalmente”, il che per un algoritmo significa classificarci più nella media. Ecco perché dobbiamo tutelare il nostro diritto alla privacy, che in sostanza corrisponde al nostro diritto di essere diversi. Si potrebbe affermare che la privacy è il diritto di essere imperfetti». L’inaffidabilità degli algoritmi di riconoscimento facciale viene rimarcata nel documentario, rendendo evidente quanto risulti piuttosto semplice manipolare i punteggi. Ad esempio, spostare il capo in alto o in basso modifica la previsione dell’età e sollevare semplicemente le sopracciglia può tradursi in un IMC inferiore. Inoltre, le valutazioni dell’algoritmo nei confronti della bellezza sono distorte poiché si basano sui punteggi di bellezza forniti unicamente da studenti cinesi. I modelli di IA usati nel documentario vengono eseguiti direttamente nel browser del visitatore affinché non venga trasferito alcun dato nel cloud.

Privacy in casa

Tijmen Schep ha lavorato come capo progettista per un altro sistema supportato dal progetto SHERPA, che ci fa riflettere su come potrebbe apparire una casa intelligente se la privacy fosse la priorità principale. Il nuovo sistema per case intelligenti rispettoso della privacy denominato Candle(si apre in una nuova finestra) è stato concepito per archiviare tutti i dati all’interno della casa senza aver bisogno di una connessione internet per funzionare. Ciò è dovuto al fatto che, a differenza di altri sistemi per case intelligenti, questa soluzione è provvista di comandi vocali a livello interamente locale. Tra le funzionalità di Candle figurano sensori di temperatura, umidità, livello di CO2, polvere e consumo di elettricità, nonché allarmi e serrature intelligenti. Al fine di riconsolidare la fiducia delle persone nei sistemi informativi intelligenti in seguito a diversi scandali di violazione della privacy, i creatori del sistema Candle hanno reso gratuitamente disponibile il codice sorgente. «Il nostro obiettivo è quello di accelerare il passo del settore verso la realizzazione di prodotti rispettosi della privacy, mostrando esempi innovativi delle possibili configurazioni di questi prodotti», ha affermato Schep sul sito web di Candle. Il progetto SHERPA (Shaping the ethical dimensions of smart information systems (SIS) – a European perspective) si propone di trovare soluzioni sostenibili a favore non solo degli innovatori tecnologici, ma anche della società che ne fa uso. Il progetto si concluderà a ottobre 2021. Per ulteriori informazioni, consultare: sito web del progetto SHERPA(si apre in una nuova finestra)