Uczenie robotów rozwijania swojej wiedzy

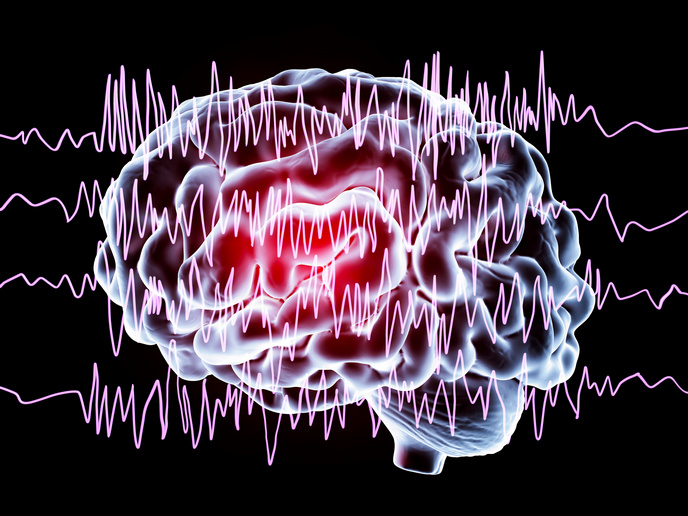

Celem konsorcjum o nazwie SIGNAL było opracowanie urządzenia, które mogłoby „rozwinąć się”, począwszy od systemu infantylnego do jednostki w pełni dojrzałej. By wypełnić to zadanie, partnerzy projektu stworzyli interdyscyplinarny zespół obejmujący grupy badaczy z dziedziny techniki informacji oraz nauki o życiu. Dopomaganie robotowi w jego „rozwoju” realizowane było poprzez połączoną strategię znaną jako architektura systemowa. „Rozwój” i pogłębianie wiedzy poprzez proces uczenia się i nabierania doświadczenia stanowi główną cechę istot żyjących. Zespół naukowców realizował szkolenie systemu sterowania robota przy wykorzystaniu związków podobieństwa zasad (RLA), w oparciu o sztuczny system odpornościowy. System RLA może być pomyślnie zastosowany do sterowania robota oraz szkolenia jego postępowania poprzez nasilenie uczenia. System RLA umożliwia budowanie systemowej hierarchicznej architektury, co pomaga w „rozwijaniu wiedzy”. Każdy z systemów RLA zatrzymuje informacje o środowisku robota i składa się z trzech części. System RLA obejmuje warunek detekcji, C, instrukcję działania, A, oraz spodziewany, następujący wkrótce, sygnał detekcji na wejściu, E. Naukowcy stworzyli systemy RLA wykorzystując krótkotrwałą pamięć, która magazynuje skrócone sekwencje informacji dotyczącej zdarzeń zrealizowanych i istotnych zdarzeń detekcji, oraz przemieszczenia. Informacje przechowywane w pamięci krótkotrwałej wykorzystywane są jako baza do tworzenia nowych systemów RLA. System RLA obejmuje jednak element przewidywania E, dotyczący konsekwencji działania. Tak więc, system RLA może być stworzony jedynie wtedy, gdy system robota posiada informacje dotyczące konsekwencji E po zrealizowaniu działania A. Łączenie systemów RLA w sposób umożliwiający stworzenie sieci, zwiększa poziom wiedzy, jaką posiada robot o swoim środowisku. Robot, który posiada czujniki na podczerwień oraz jest autonomiczny i ruchomy, umożliwia zademonstrowanie postępowania, takiego jak przemieszczanie się wzdłuż ściany lub unikanie przeszkód. Rezultaty wykazały, że roboty nie muszą już być programowane, jeśli można je nauczyć wykonywania zadań poprzez realizację działań i ocenę wynikającego z tych działań postępowania.