Datengewinnung am Large Hadron Collider

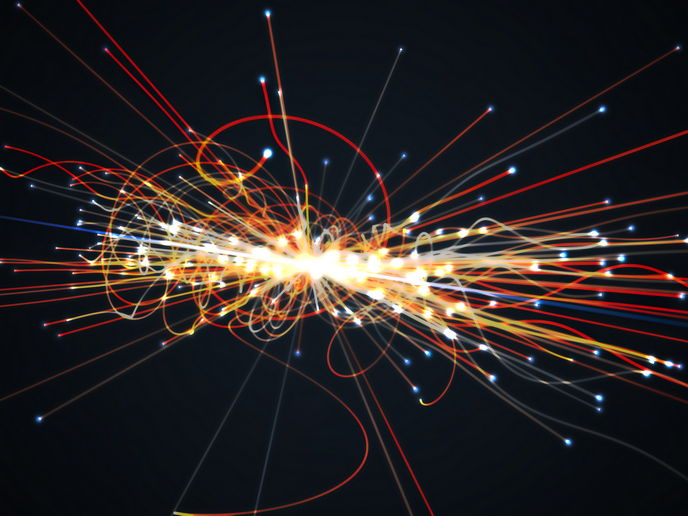

Im Großen Hadronen-Speicherring (Large Hadron Collider, LHC) der Europäischen Organisation für Kernforschung (CERN) in der Schweiz finden riesige Mengen an Kollisionen und Interaktionen statt. Eine Datenanalyse dieser Ereignisse hat wesentliche Bedeutung für die Entdeckung neuer Teilchen. PDF sind Werkzeuge, die eingesetzt werden, um die Dynamik zu verschlüsseln, die bestimmt, wie die Energie eines Protons bei jeder Kollision unter seinen Bestandteilen aufgeteilt ist. Diese Parton-Verteilungsfunktionen extrahierte man aus experimentellen Daten. Das EU-finanzierte Projekt "Precision parton distribution for new physics discoveries at the Large Hadron Collider" (DISCOVERY@LHC) hat nun einen neuartigen Ansatz dafür erdacht. Das neue Verfahren setzt auf künstliche neuronale Netzwerke, Verfahren des maschinellen Lernens und Genetikalgorithmen, um die PDF aus den Versuchsdaten zu extrahieren. Dadurch entfällt die Notwendigkeit der Einführung einer vorausgehenden Theorie. Der Projekt Forscher veröffentlichte die erste PDF, welche die direkten Nebenbedingungen aus den LHC-Daten enthält, mit der Bezeichnung Neural Network Parton Distribution Functions NNPDF2.3. Andere am LHC arbeitende Wissenschaftler haben zunehmend damit begonnen, diese NNPDF-Sätze anzuwenden. Mitte 2013 stellte der Forscher den ersten NNPDF-Satz mit Quantenelektrodynamikeffekten vor. Das Projekt hat sein Hauptziel erreicht. Es konnte eine neue Generation von Partonverteilungen zum Einsatz bei der Untersuchung von LHC-Phänomenen bereitgestellt werden.