L'extraction de données et le Grand collisionneur de hadrons

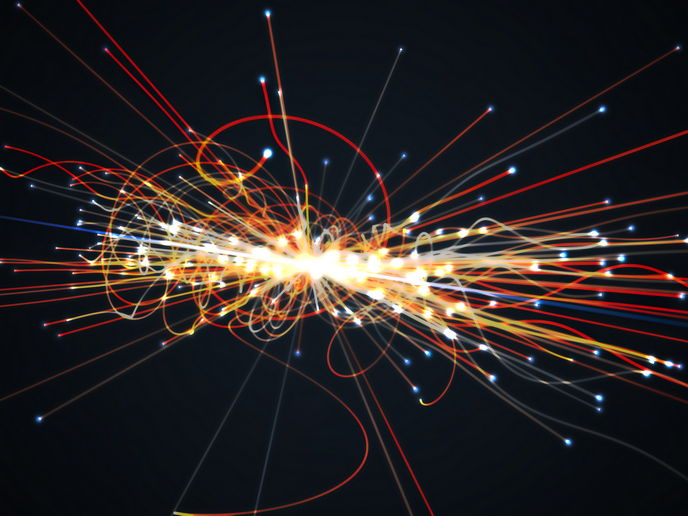

Le Grand collisionneur de hadrons, LHC, sur le site du CERN (l'Organisation européenne pour la recherche nucléaire) en Suisse, est le siège de très nombreuses collisions et interactions entre des particules. Pour découvrir de nouvelles particules, il est essentiel d'analyser les données correspondantes. Les fonctions de distribution de Parton servent à définir la dynamique qui détermine comment l'énergie d'un proton est répartie entre ses constituants lors de chaque collision. Ces fonctions doivent être extraites des données expérimentales. Le projet DISCOVERY@LHC («Precision parton distribution for new physics discoveries at the Large Hadron Collider») a conçu une nouvelle approche dans ce but. Elle utilise des réseaux neuroniques artificiels, des techniques d'apprentissage machine et des algorithmes génétiques pour extraire les fonctions de distribution de Parton à partir des données expérimentales. Ceci évite d'appliquer une théorie préalable. Les chercheurs ont publié le premier ensemble de fonctions de distribution de Parton incluant les contraintes directes pour les données du LHC, et l'ont nommé Neural Network Parton Distribution Functions NNPDF2.3. L'usage de ces ensembles NNPDF commence à se développer auprès des autres scientifiques travaillant au LHC. Fin 2013, les chercheurs ont publié le premier ensemble NNPDF présentant des effets d'électrodynamique quantique. Le projet a atteint son objectif premier, apporter une nouvelle génération de distributions de Parton pour étudier les expériences conduites au LHC.