Zmysł dotyku

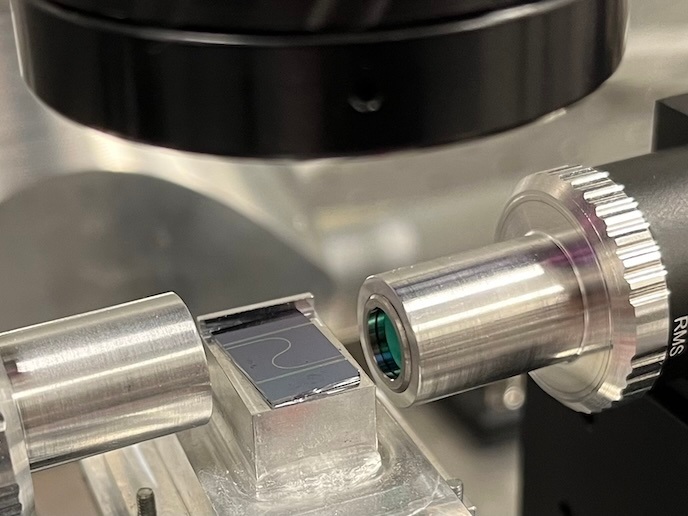

Interpretując bodźce pochodzące z otoczenia, tworzymy jego obrazy, na których możemy oprzeć swoje działania, myśli oraz automatyczne reakcje. Ten zdumiewająco złożony proces przyjmuje się za oczywisty, dopóki nie dojdzie do utraty któregoś ze zmysłów. Za główny cel projektu o stosownej nazwie SENSEMAKER przyjęto utworzenie elektronicznych urządzeń z wejściem informacji zmysłowych o różnych modalnościach. W wyniku przetwarzania tych informacji użytkownik miał otrzymywać reprezentację swojego otoczenia. Oprogramowanie powinno być zdolne do selektywnego przetwarzania informacji o różnych modalnościach tak jak mózg, który jest zdolny wyodrębnić niezbędne informacje z reprezentacji zmysłowych. Uczestnicy projektu użyli zmysłów wzroku, słuchu i dotyku w połączeniu z wewnętrznym systemem sterowania silnikiem. Jako biologiczną część projektu uczestnicy z Trinity College w Dublinie w Irlandii wybrali badanie zmysłu dotyku oraz tryb, jakim przebiega interpretacja jego sygnałów w mózgu. Wiedza o tym, jak centralny układ nerwowy przetwarza informacje zmysłowe ma kluczowe znaczenie w projektowaniu oprogramowania na potrzeby projektu. Wiadomo na przykład, że zmysł wzroku działa dwojako: jeden sposób odpowiada za postrzeganie przestrzenne, drugi za rozpoznawanie obiektów. Zespół wykorzystał do badania reakcji na nieznane bodźce zarówno parametry behawioralne, jak i obrazowanie funkcjonalne w rezonansie magnetycznym. Obrazy rezonansowe pokazały, że informacje o wrażeniach dotykowych zajmują wspólną sieć obszarów w korze mózgowej. Generalnie jednak za informacje przestrzenne odpowiada szlak potyliczno-ciemieniowy, natomiast rozpoznawanie odbywa się szlakiem potyliczno-skroniowym. Wnioski te znalazły wsparcie w testach behawioralnych, które wykazały, że te dwie funkcje są zależne od zadania i nie dochodzi między nimi do współoddziaływania. Co interesujące, wrażenia wzrokowe mają wpływ na dotykowe postrzeganie przestrzeni i obiektów, a gdy informacje wzrokowe są ograniczone, działania zostają usprawnione w wyniku łącznego wykorzystania bodźców z tych dwóch zmysłów. We współpracy z Electronic Vision Group w Kirchhoff-Institut für Physik na Uniwersytecie Heidelberskim zespół z Dublina opracował urządzenie VHD (ang. Virtual Haptic Display, ekran dotykowo-czuciowy rzeczywistości wirtualnej). Jego innowacyjność względem poprzedniego modelu polega na tym, że nie bazuje ono na biernym odbieraniu bodźców, lecz wymaga aktywnego badania wirtualnego otoczenia. Obraz jest prezentowany w całości albo częściowo za pomocą regulowanej przesłony. Potencjalne zastosowania tej technologii są bardzo szerokie. Mogą skorzystać z niej pacjenci o upośledzonym postrzeganiu zmysłowym, a także może ona posłużyć jako pomoc w uczeniu się oraz do analizy i obrazowania w sytuacjach niebezpiecznych. Obecne i przyszłe zastosowania tej technologii w robotyce kognitywnej, systemach autonomicznych oraz inteligencji rozproszonej są oczywiste.